Das österreichische Bundesamt für Fremdenwesen und Asyl plant den Einsatz künstlicher Intelligenz zur Beschleunigung von Asylverfahren. Unter dem Namen A.I.SYL sollen künftig Chatbots Herkunftsländerdaten bereitstellen und KI-Modelle Informationen automatisiert analysieren, kategorisieren und zusammenfassen, berichtet die Zeitung Junge Freiheit. Doch ein Grazer Forschungsprojekt warnt vor erheblichen Risiken.

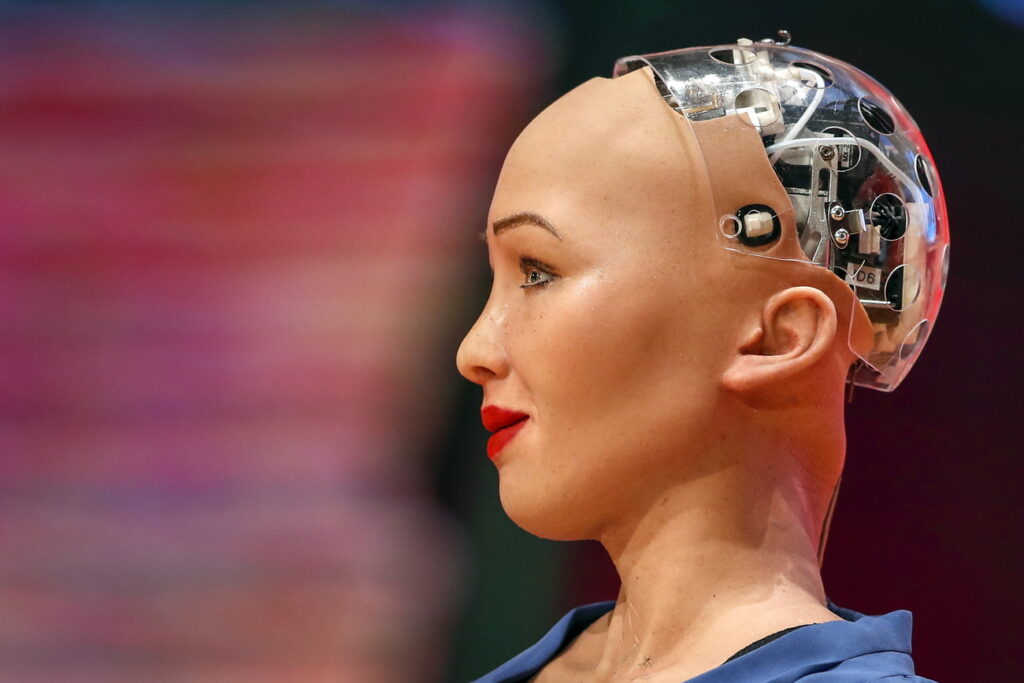

RITCHIE B. TONGO / KEYSTONE

Die Universität Graz hat die geplanten Systeme ein Jahr lang untersucht – mit ernüchterndem Fazit. «Keines der getesteten Werkzeuge konnte das Verfahren nachweislich fairer oder rechtsstaatlicher gestalten», so die Studienautoren. Vielmehr bestehe die Gefahr eines «gefährlichen Experiments auf dem Rücken von Schutzsuchenden».

Kritik entzündet sich besonders an der sogenannten Staatendokumentation. Diese liefert sicherheitsrelevante Informationen zu Herkunftsländern und soll künftig durch KI ausgewertet werden. Doch sogenannte Halluzinationen – also erfundene Inhalte – und die Reproduktion von gesellschaftlichen Vorurteilen könnten zu falschen Entscheidungen führen.

Auch die Auswertung von Mobiltelefonen zur Ermittlung von Identitäten und Reiserouten wird kritisch gesehen. Verknüpft mit den Herkunftsdaten und automatisiert analysiert, könnte dies tief in die Grundrechte der Asylbewerber eingreifen.

Ein zentrales Problem sei zudem die Intransparenz: KI-Modelle wie Large Language Models lieferten Ergebnisse, deren Zustandekommen kaum nachvollziehbar sei – ein unhaltbarer Zustand für rechtsstaatliche Verfahren, so Co-Autorin und Juristin Angelika Adensamer: «Es braucht eine klare gesetzliche Grundlage.»

Meine Favoriten

Meine Favoriten Abmelden

Abmelden